前言

现在迷你AI电脑比较火,我也跟风买了一台,这样就可以在家跑模型。(主要是好奇,想玩)

迷你电脑配置如下:

- 型号:零刻 GTR9 Pro

- CPU:AMD Radeon AI Max+ 395

- 显卡:AMD Radeon 8060S 集成显卡(无独立显卡)

- 内存:128GB LPDDR5X 8000MT/s

- 硬盘:2TB M.2 PCIe 4.0×4 7000MB/s

这款机器支持手动调节内存/显存分配,我给GPU分配了64G显存。

实测运行目前几款主流的AI大模型的效率如下:

- Gemma4 26B A4B:60+ token/s

- Gemma4 31B:30+ token/s

- Qwen3.6 35B A3B:60+ token/s(略优于 Gemma4 26B A4B)

- GPT OSS 20B:40 token/s

- GLM4.7 Flash:35 token/s

以上模型运行的全部是Q4量化版本。

实测下来,个人感觉 Qwen3.6 35B A3B 的编码能力和工具调用能力最强。尤其是让它实现单网页,能力非常突出。Gemma4 26B A4B 和 Gemma4 31B 的工具调用能力较差,在 OpenClaw 中表现不好,经常会聊着聊着“失联”。GLM 4.7 Flash 的文章编写能力更好,但速度比较慢。

配置建议:

迷你工作站的优缺点很明显。

优点:

- 机身小,放在桌面上就行

- 噪音小

- 功耗低,实测峰值100W出头

- 即使是玩3A游戏,性能也绝对够用

- 价格相比专业服务器会便宜很多

缺点:

- 核显性能不足,tokens输出速度不够

- 显存够用但是传输速度慢,因为迷你电脑的显存是由内存转换来的。尤其是在你接入

Claude Code这种专业工具以后,每次输入可能要等很久才有输出结果。大量的输入参数以及无法命中的缓存虽然不会把你的内存撑爆,但是传输速度太过感人

如果你和我一样预算不足并且只是研究学习目的,可以考虑这种迷你工作站。

如果想玩得更专业一点,个人更推荐家庭服务器:

- 主板:多显卡槽+内存槽,建议技嘉 MU72 SU0

- CPU:建议 INTEL 8347C

- 内存:需要采用ECC内存,不跑大模型的话,64G足够

- 显卡:建议用专业计算卡,效率最高。可选 Nvidia A4500 20G * 2,这样性价比最高。

有条件的直接上 A5000 PRO、A6000 PRO

上面这套配置大概3w出头可以拿下,但是性能相比我这台2w多的迷你工作站提升很多。而且因为都是服务器用的硬件,稳定性可以保证

作为参考:9B参数量模型大概需要15G显存,30B参数量(Q4量化后)的模型最少需要30G显存

正文

1: 系统环境

我这里是一个新机器,装了 Windows 11 专业工作站最新版本。没有装 Ubantu 就是图省事,Windows用惯了。

2: 安装前提

- 一台配置还可以的电脑/服务器

- 会上网手段。时间不浪费在寻找镜像源上面

3: 配置 LM Studio

我分别尝试了 Ollama、Unsloth Studio和LM Studio。根据软硬件适配度和使用便捷度,最终决定使用LM Studio。本文也以LM Studio为例。

3.1: 下载&安装

前往 LM Studio 官网:https://lmstudio.ai/,点击 Download for Windows 按钮下载(当前最新版本为0.4.12),然后安装

3.2: 配置

这一步主要是为了将本地模型接入 OpenClaw、Hermes Agent 或 Claude Code,如果你只需要在聊天框与模型聊天,没有其他需求,那么这一步不用做

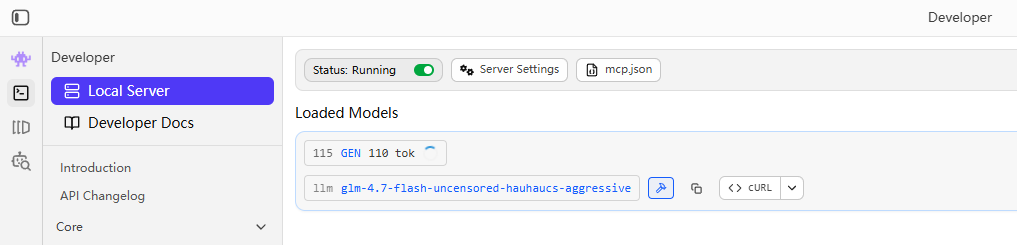

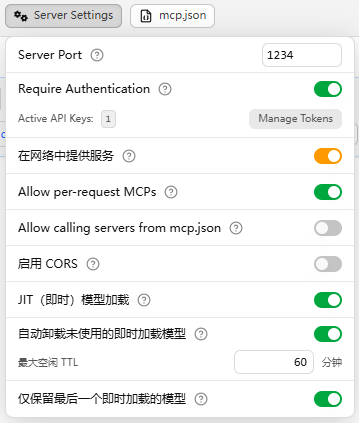

打开 Developer - Local Server 侧边栏,启用本地服务。

启用认证:

- 点击

Server Settings,启用Require Authentication - 点击下方

Manage Tokens,然后点击Create new token,把生成的 API Key 保存到本地,后续连接小龙虾时要用

在网络中提供服务 这一项,如果你需要在其他电脑上使用本机部署的模型则启用,否则不用启用

其他选项按需配置

3.3: 模型下载

点击左侧菜单栏中的机器人+放大镜图标,输入关键词查找模型(模糊查询),点击对应的模型,然后右侧 Download 下载

完成后点击 Load Model 即可聊天,你可以在右侧自定义一些模型参数,鼠标悬停在参数标签上时会弹出参数介绍

建议把主流的模型都下载下来,都试过才知道哪个最适合自己。建议的模型:Qwen3.6系列、GLM4.7、Gemma4系列

4: 配置 OpenClaw

4.1: 安装

如果你已经装过了,这一步可以跳过

win + r,输入powershell,回车- 在打开的窗口中输入

powershell -c "irm https://openclaw.ai/install.ps1 | iex",回车 - 等待安装完成

- 访问指令提示的URL(包含Token),发现可以正常访问 OpenClaw 控制台页面

4.2: 配置

- 新开一个 cmd 窗口,输入

openclaw config Where will the Gateway run?,选择 `Local (this machine)Select sections to configure,选择ModelModel/auth provider,选择LM StudioLM Studio base URL,如果 OpenClaw 安装在部署了 LM Studio 的机器上,这里输入http://localhost:1234,否则需要把localhost改为局域网IP。注:记得防火墙放行,否则访问不到LM Studio API key,输入3.2: 配置中获取到的 API KeyPreferred context length to load LM Studio models with (optional),这是上下文长度。你可以自己输入,也可以直接回车Model configured,选择你希望 OpenClaw 使用的默认模型(在 OpenClaw 的网页端也可以修改聊天模型)- 以上步骤完成后你发现又回到了

Select sections to configure,选择最后一项:Continue (Done) - 输入

openclaw gateway restart - 回到 OpenClaw 控制台页面,刷新一下,然后点击左侧聊天按钮,选择本地模型,测试一下是否可以正常聊天了